本贴将介绍如何使用超级模型包识别纸箱/麻袋。

1. 获取超级模型包

2. 在Mech-Vision中部署超级模型包

3. 查看识别效果

4. 在Mech-DLK中微调超级模型(可选)

注意事项: 当识别效果不够理想时,才需在Mech-DLK中微调超级模型。

术语解释: 超级模型包,即梅卡曼德提供的通用模型,用于识别纸箱或麻袋。如果识别效果欠佳,可使用 Mech-DLK 对模型进行微调。

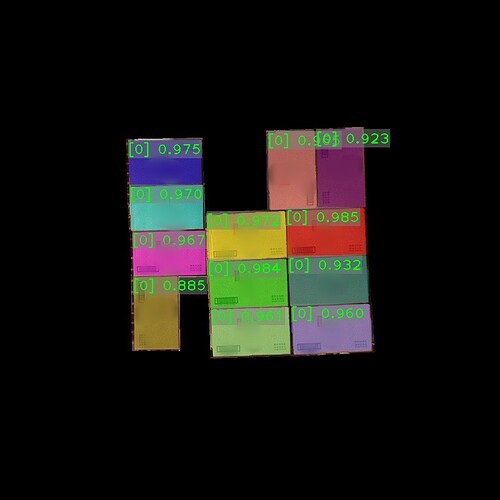

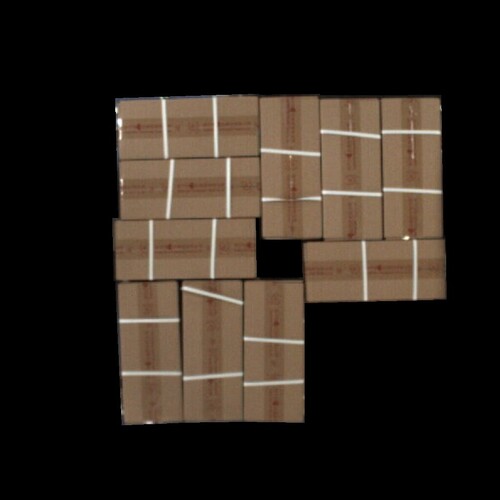

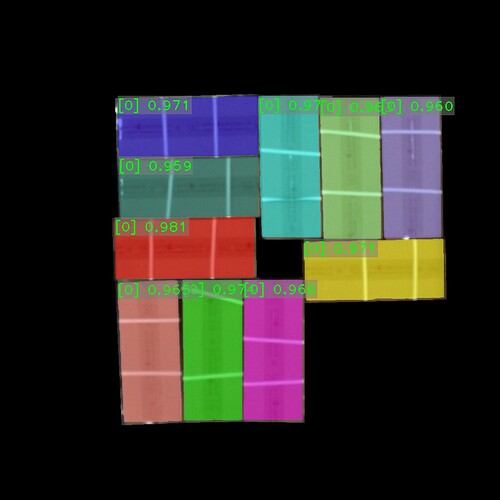

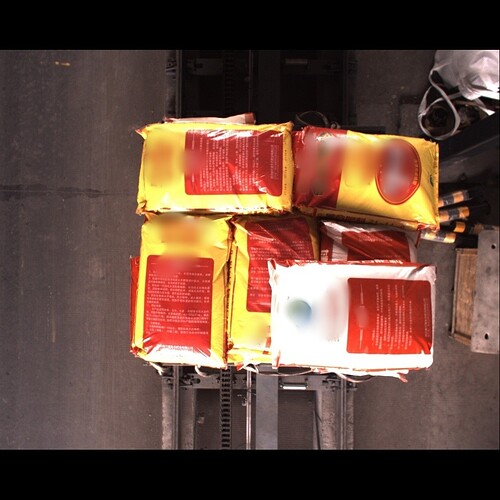

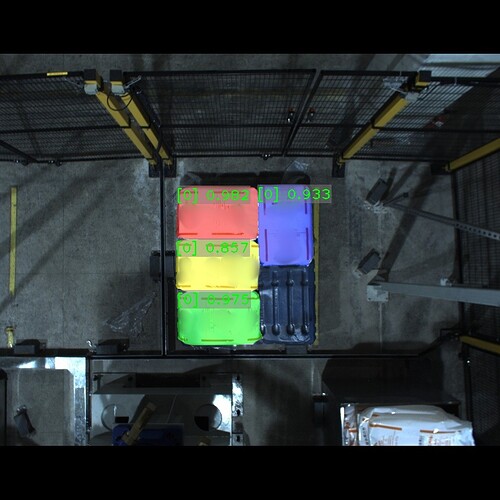

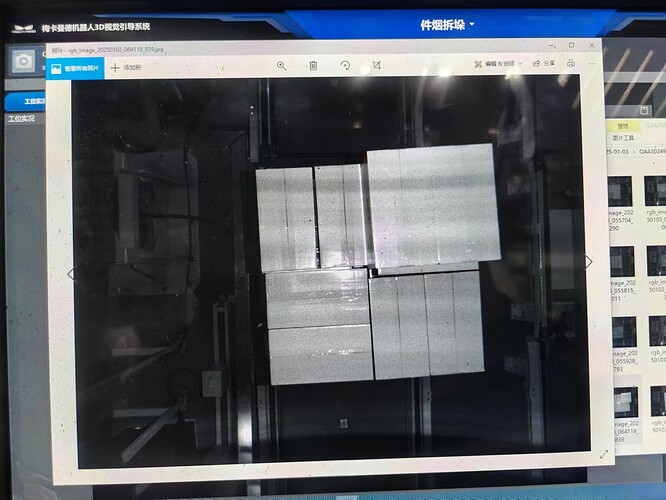

最终的定位识别效果如下图所示,左图为纸箱和麻袋的2D图,右图为深度学习识别效果。

获取超级模型包

由于Mech-Vision需利用超级模型包进行推理,完成对纸箱/麻袋的识别,所以需获取用于纸箱/麻袋的识别的模型包。

在下载中心下载Mech-Vision可用的超级模型包。

注意事项:

- 识别精确度: 相比CPU模型包,GPU模型包可识别出更精确的物体轮廓。

- 计算速度: 在实验室测试条件下(Intel Core 12th i5-12400 vs NVIDIA GTX 1050Ti),CPU模型包的推理速度与GPU模型包基本一致。

在Mech-Vision中部署超级模型包

导入超级模型包

将超级模型包导入深度学习模型包管理工具。

使用超级模型包进行推理

使用深度学习模型包推理步骤利用导入好的超级模型包对纸箱/麻袋的图像进行推理。

提示: 模型包推理指的是经过训练的深度学习模型对数据进行推理,从而实现各种各样的任务,如图像分类、实例分割等。

查看识别效果

超级模型包推理完成后,即可在Mech-Vision中查看识别效果。

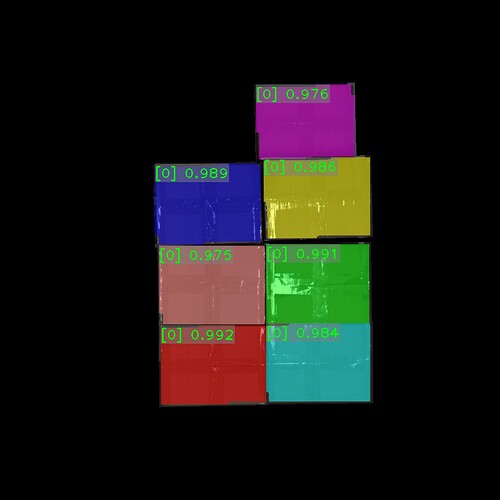

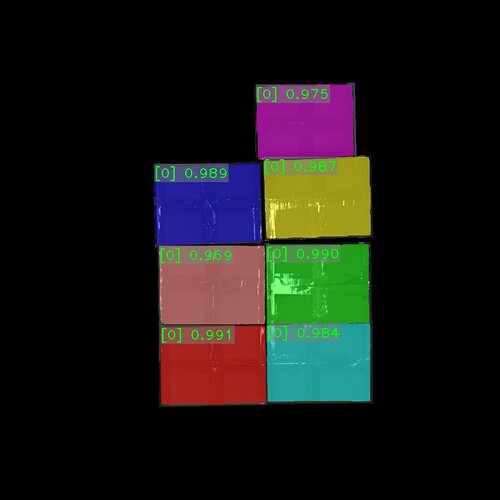

纸箱识别效果展示

纸箱识别效果如下表所示(可点击查看大图)。图中数字为置信度,即识别表现评分。彩色掩膜边缘轮廓即识别出的纸箱边缘轮廓。纸箱识别结果的边缘轮廓可达到较高贴合度。

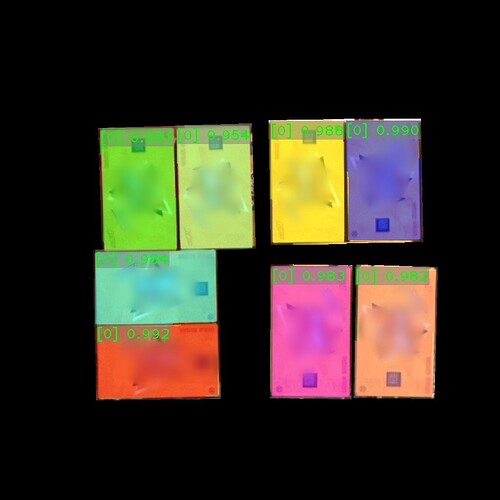

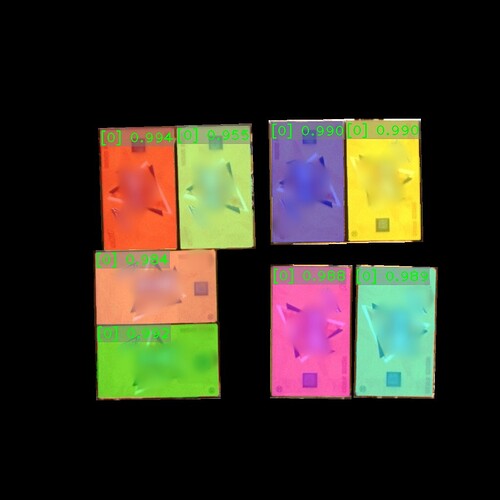

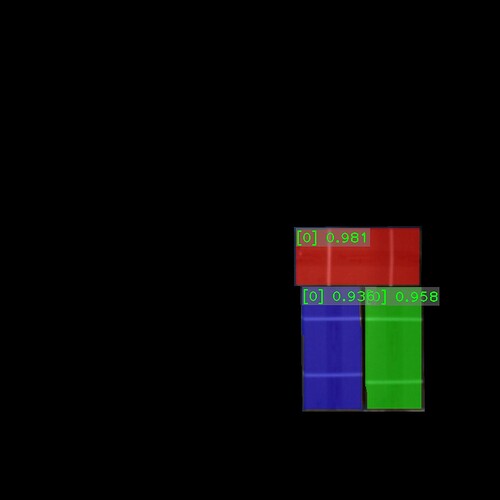

麻袋识别效果展示

麻袋识别效果如下表所示(可点击查看大图)。图中数字为置信度,即识别表现评分。彩色掩膜边缘轮廓即识别出的麻袋边缘轮廓。麻袋识别结果的边缘轮廓可达到较高贴合度。

在Mech-DLK中微调超级模型

如果纸箱/麻袋识别效果较好,则无需进行超级模型微调。

如果纸箱/麻袋识别效果不够理想,则需在Mech-DLK中对超级模型进行微调。

获取超级模型

由于Mech-DLK不能直接对超级模型包进行微调,所以需获取该模型包对应的超级模型。

在下载中心下载Mech-DLK可用的超级模型。

微调超级模型

打开Mech-DLK软件,选择“实例分割”模块后,可参考用户手册操作。

超级模型微调完成后,即可将超级模型导出为超级模型包,再次导入Mech-Vision进行模型包推理。

识别过程中的常见问题

如何避免误识别?

- 尽量保持现场光照稳定,避免出现图像过曝、欠曝、有阴影的情况,否则会导致图像中的麻袋边缘不清晰,影响深度学习的稳定性。

- 调节相机的白平衡,保证图像不过曝、欠曝。

- 垛旁不要摆放其他与抓取无关的纸箱或麻袋,避免误识别。

- 设置合适的ROI。

如何设置合适的ROI?

需基于垛型的最大垛(满垛)来设置ROI,需保证ROI包含垛的最高和最低区域,且ROI比满垛时的垛型稍大一圈,同时ROI内尽量不包含其他干扰点云。

完成上述操作后,若深度学习识别的稳定性没有提升,则需针对该种类纸箱或麻袋对超级模型进行迭代,或使用该种类纸箱或麻袋数据对超级模型进行微调。具体内容请参考超级模型迭代。